دوربینی که احساس واقعی فرد را فاش میکند

پرسش:فناوری تشخیص چهره روز به روز پیشرفتهتر میشود؛ تاجایی که این روزها برخی شرکتها ادعا میکنند این فناوری قادر است احساسات فرد را بخواند و رفتارهای مشکوک را تشخیص دهد. اما این ویژگی چطور حریم خصوصی و آزادیهای مدنی ما را تحت تأثیر قرار خواهد داد؟

پرسش:فناوری تشخیص چهره روز به روز پیشرفتهتر میشود؛ تاجایی که این روزها برخی شرکتها ادعا میکنند این فناوری قادر است احساسات فرد را بخواند و رفتارهای مشکوک را تشخیص دهد. اما این ویژگی چطور حریم خصوصی و آزادیهای مدنی ما را تحت تأثیر قرار خواهد داد؟

فناوری تشخیص چهره سالهاست که پا به عرصه وجود گذاشته. کارشناسان میگویند این تکنولوژی در سالهای اخیر به دلیل پیشرفتهایی که در حوزه دید کامپیوتری و هوش مصنوعی صورت گرفته، با سرعت بیشتری به روز شده است.

امروزه از این فناوری برای تشخیص هویت افراد در مرزها، باز کردن قفل تلفنهای همراه، شناسایی مجرمان و همینطور تأیید نقل و انتقالات بانکی استفاده میشود.

در این میان برخی شرکتهای فناوری ادعا میکنند این تکنولوژی توانایی ارزیابی وضعیت احساسی ما را نیز دارد.

از دهه ۱۹۷۰ به این طرف، روانشناسان میگویند قادرند از طریق مطالعه " جزئیات حرکات چهره" در عکس یا فیلم، احساسات پنهان افراد را تشخیص دهند.

حق نشر عکس APPLE Image caption قفل صفحه آیفون ایکس میتواند با استفاده از فناوری تشخیص چهره باز شود

شرکتهای فناوری میگویند الگوریتمها و دوربینهای اچ دی دقت و سرعت زیادی به این فرایند بخشیدهاند.

اولیور فیلیپوو، کارشناس نظارت تصویری در شرکت " آی اچ اس مارکیت" میگوید: "این تکنولوژی همین الان هم در امور تجاری مورد استفاده قرار میگیرد. مثلا سوپرمارکتها از آن نه برای تشخیص هویت که برای تجزیه تحلیل سن، جنس و حال و هوای مشتریان خود بهره میگیرند. این فناوری میتواند به بازاریابی هدفمند و تبلیغات نامحسوس کمک زیادی بکند."

آژانس تحقیقات بازاریابی "کانتار میلوارد براون" از یک تکنولوژی که توسط شرکت آمریکایی "افکتیوا" راهاندازی شده برای ارزیابی واکنش افراد به تبلیغات تلویزیونی استفاده میکند.

افکتیوا با اجازه خود فرد از او فیلم میگیرد و برای ارزیابی حس و حالش، حالت چهره او در هر فریم از تصویر را "کدگذاری" میکند. گراهام پیج، مدیر بخش نوآوری در شرکت کانتار میلوارد براون میگوید: "ما با افراد مصاحبه میکنیم اما بیشتر از آن، از نگاه کردن به حالت چهره آنها به جزئیات بیشتری پی میبریم. کاملا میشود فهمید کدام بخش از آگهی دارد کارش را درست انجام میدهد و آن تأثیر احساسی که باید را روی بیننده گذاشته."

حق نشر عکس WESEE Image caption فناوری ویسی برای ارزیابی احساسات افراد در هنگام مصاحبه استفاده میشود

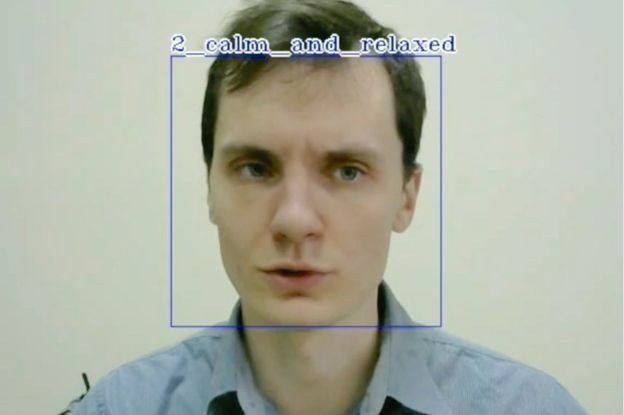

چندین شرکت استارتآپ، اخیرا فناوری " تشخیص احساسات" را به بازار عرضه کردهاند که سر و صدای زیادی هم به پا کرده. به عنوان مثال شرکت بریتانیایی "ویسی" (ما میبینیم) ادعا میکند فناوری هوش مصنوعیاش توانایی شناسایی رفتارهای مشکوک را دارد و این کار را از طریق خواندن حالات چهره که با چشم در حالت عادی قابل رویت نیستند انجام میدهد.

احساساتی مثل شک و خشم ممکن است توسط فرد پنهان شود و مغایر با حرفهایی باشند که او به زبان میآورد.

شرکت ویسی ادعا میکند یک نهاد شناخته شده از این فناوری برای تجزیه و تحلیل واکنش افراد در هنگام بازجویی استفاده کرده است.

دیوید فالتن، مدیر عامل این شرکت به بیبیسی گفت:" فناوری ما با بهرهگیری از تصاویر ویدئویی با کیفیت پائین قادر است از طریق خواندن حالات چهره، طرز قرارگیری بدن و حرکات دست و صورت، وضعیت ذهنی فرد و قصد و نیت او را تشخیص دهد. در آینده، دوربینهای تصویربرداری ایستگاههای مترو هم میتوانند با استفاده از این تکنولوژی رفتارهای مشکوک را شناسایی و مقامات را از خطر احتمالی حمله تروریستی آگاه کنند. این فناوری همچنین میتواند در رویدادهای مختلف از جمله مسابقات ورزشی و راهپیماییهای سیاسی در میان جمعیت مردم مورد استفاده قرار بگیرد."

Image caption آیا فناوری نظارت بر احساسات، توانایی تشخیص افرادی که ممکن است در رویدادهای بزرگ دردسر ایجاد کنند را دارد؟

با همه این تفاسیر اولیور فیلیپو شک دارد این تکنولوژی کاملا دقیق عمل کند: " وقتی صحبت از تشخیص چهره به میان میآید، هنوز هم جا برای اشتباه وجود دارد؛ حتی بهترین شرکتها هم دقت تشخیصشان را بین ۹۰ تا ۹۲ درصد برآورد میکنند. وقتی هم که نوبت به ارزیابی احساسات میرسد، این درصد خطا به شکل قابل توجهی بالاتر میرود."

ظهور این فناوری باعث نگرانی فعالان مدافع حریم خصوصی شده است؛ کسانی که معتقدند تشخیص چهره میتواند به قضاوتهای اشتباه و متعصبانه منجر شود. فردریکه کالتوینر از اعضاء بنیاد خیریه "پرایوسی اینترنشنال" در این باره میگوید: "میتوانم تصور کنم این تکنولوژی چه کاربردهای مفیدی دارد اما نظارت بر احساسات، تشخیص چهره و پیشداوری از روی آن، حریم خصوصی افراد را به شکل بیسابقهای تحت تأثیر قرار داده است."

حتی فناوری ساده و قابل فهم تشخیص چهره هم به خودی خود به اندازه کافی جنجال برانگیز است.

حق نشر عکس SOUTH WALES POLICE Image caption در ولز پلیس با دوربینهای نظارتی چهره افراد را اسکن میکند

در جشنواره سالانه موسیقی رادیو بیبیسی که ماه مه در ولز برگزار شد، بسیاری از حضار از وجود دوربینهای نظارتی که چهرهشان را اسکن میکرد بیخبر بودند.

پلیس ولز در این عملیات نظارتی عظیم از سیستم تشخیص هویت اتوماتیک استفاده کرد که با بهرهگیری از دوربینهای مداربسته و نرمافزار محصول شرکت "ان ای سی" هویت افراد مظنون را شناسایی میکرد. اسکات لویدز، مدیر این پروژه گفت ۱۰ دقیقه بعد از به کار انداختن این فناوری یک مرد شناسایی و دستگیر شد.

با این حال گروه حقوق بشری " لیبرتی" معتقد است این فناوری در برخی رویدادها تشخیص اشتباهی داده، از جمله فینال لیگ قهرمانان اروپا که سال گذشته در کاردیف برگزار شد. (به گزارش بیبیسی، در جریان این بازی تکنولوژی اسکن چهره بیش از ۲۰۰۰ نفر را به طور اشتباهی به عنوان مجرم بالقوه شناسایی کرد.)

با همه این تفاسیر پاتریک گروتر، رئیس بخش سنجش بیولوژیکی موسسه استاندارد و فناوری آمریکا که روی تشخیص هویت تحقیق میکند، میگوید این تکنولوژی روز به روز قابل اعتمادتر میشود.

حق نشر عکس AFP Image caption پلیس چین به تازگی از عینکهایی آفتابی استفاده میکند که به سیستم تشخیص چهره مجهز هستند

او پیشرفتهای حوزه فناوری را مدیون ابداع سیستمی میداند که "شبکه عصبی پیچشی" نام دارد. شبکه عصبی پیچشی یک رده پیشرفته از یادگیری ماشینی است که دقت را به میزان زیادی بالا میبرد: " این الگوریتمها کامپیوترها را قادر میسازند تا تصاویر را در اندازهها و زوایای مختلف تجزیه و تحلیل کنند. به این ترتیب چهرهها با دقت بیشتری شناسایی میشوند، حتی اگر بخشی از آنها توسط عینک یا روسری پوشیده شده باشد. از سال ۲۰۱۴ به این طرف میزان خطا ده برابر کاهش پیدا کرده. با این حال هیچ الگوریتمی بیعیب و نقص نیست."

دیوید فالتن هدف از راهاندازی این تکنولوژی را صرفا کمک به افراد برای ارزیابی هر چه آگاهانهتر تصاویر ویدئویی میداند. او میگوید نرمافزار ویسی در تشخیص احساسات مثل یک انسان عمل میکند و "دقتی در حدود ۶۰ تا ۷۰ درصد" دارد: " در حال حاضر ما تنها قادر به شناسایی رفتار مشکوک هستیم و نمیتوانیم قصد و نیت افراد را تشخیص دهیم تا جلوی اتفاقات بد را بگیریم. اما داریم به این سمت پیش میرویم و در این زمینه آزمایشهایی هم انجام دادهایم."

این طور که پیداست یک قدم بیشتر به ایده" پیشبینی جنایات و جرایم پیش از وقوع آنها" نزدیک شدهایم، مفهومی که در فیلم علمی تخیلی "گزارش اقلیت" مطرح شد. اما آیا این موضوع میتواند نگرانی سازمانهای مدافع آزادیهای مدنی را بیشتر کند؟

فردریکه کالتوینر میگوید: "سوال کلیدی که همیشه از خودمان میپرسیم این است: چه کسی و با چه هدفی این فناوری را راه میاندازد. آیا میخواهد به ما کمک کند یا هدفش قضاوت، ارزیابی و کنترل ماست؟"

###